1.1.- Historia

"Hemos estado moldeando la IA durante mucho tiempo, pero ahora la IA comienza a moldearse a sí misma."

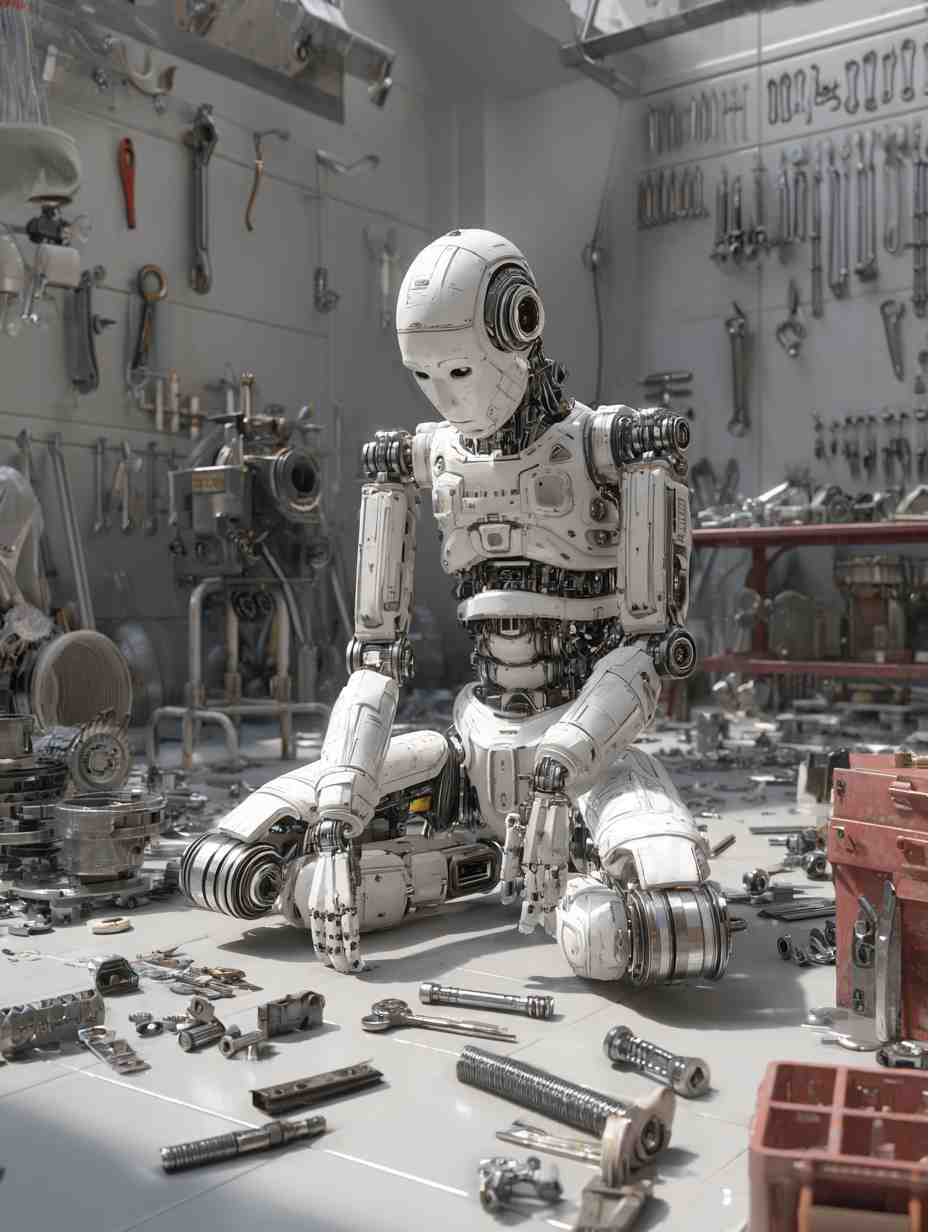

La Artificiología es un campo nuevo que se centra en cómo la inteligencia artificial (IA) podría crecer y evolucionar por su cuenta, especialmente cuando empiece a tener forma física real (por ejemplo, con un cuerpo robótico) que pueda percibir y moverse en el mundo real.

Aunque la disciplina la presenté de forma oficial durante una conferencia inaugural que impartí en Ars Electronica Festival en septiembre de 2024 en la ciudad de Linz, en realidad somos muchos lo que llevamos décadas reflexionando sobre esta idea.

Los primeros indicios de la Artificiología se remontan a la década de 1950, cuando pioneros como Alan Turing, John McCarthy y Marvin Minsky se plantearon preguntas revolucionarias tales como, ¿Pueden pensar las máquinas? Y si lo hacen, ¿cómo lo sabríamos? Por aquel entonces, la mayor parte de la investigación en IA se centraba en el "razonamiento simbólico". Esto consistía en programar gran cantidad de reglas lógicas en ordenadores, con la esperanza de que dichas reglas capturaran la esencia del pensamiento. Aunque ese enfoque produjo programas capaces de realizar muy bien determinadas tareas —como resolver problemas matemáticos o jugar a ciertos juegos— se quedaba corto cuando las tareas se complicaban o cuando el mundo cambiaba de formas inesperadas (algo que sucede a menudo). En otras palabras, aquellos primeros sistemas de IA eran muy competentes en ámbitos específicos, pero no se adaptaban bien a situaciones nuevas, algo que es crucial en la inteligencia humana.

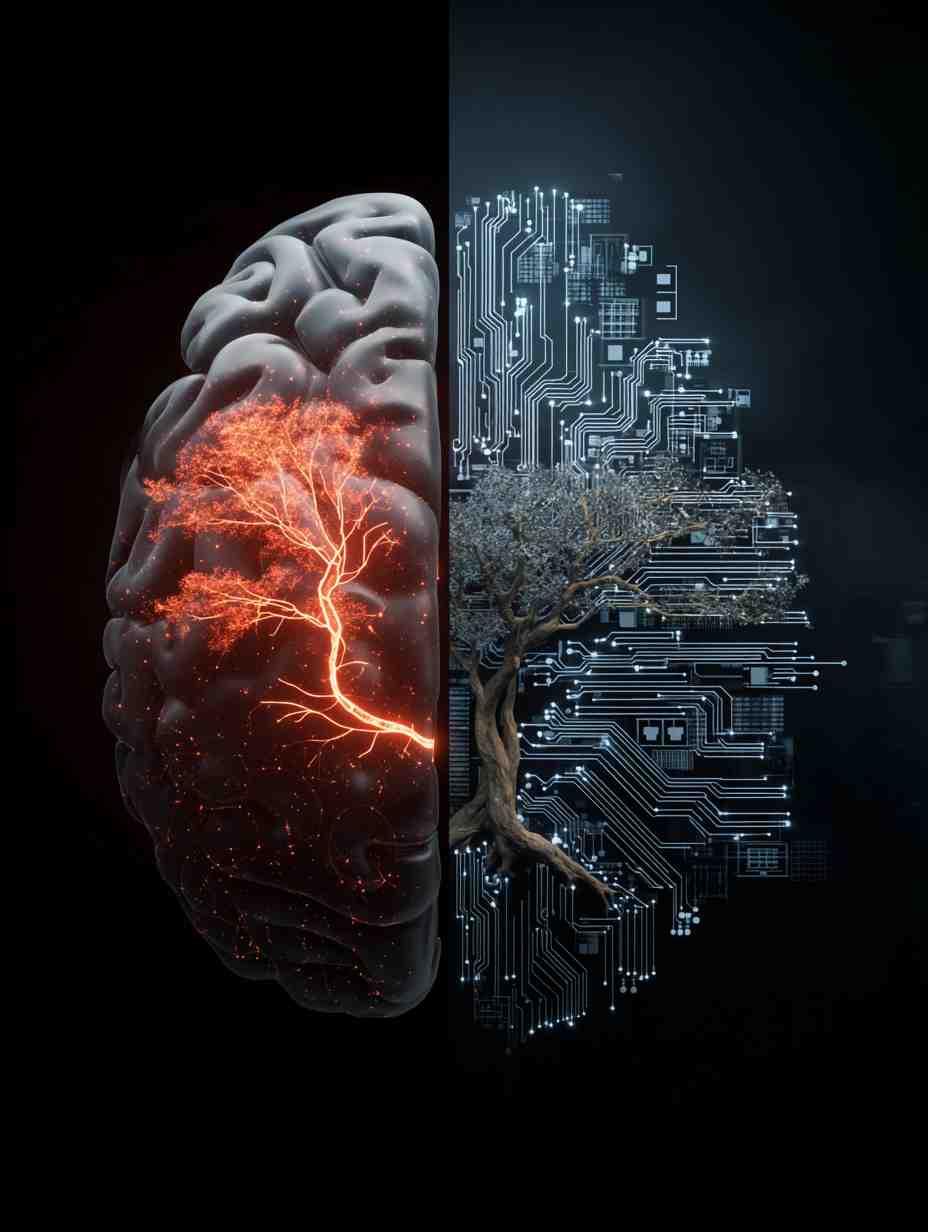

A partir de la década de 1980, los investigadores comenzaron a inclinarse hacia las redes neuronales, en parte inspirados por el funcionamiento del cerebro humano. Las redes neuronales básicamente son capas de pequeñas unidades de procesamiento (una especie de "neuronas" artificiales) que pueden aprender patrones a partir de ejemplos. Un paso fundamental fue permitir que estas redes se "ajustaran" cada vez que fallaban en alguna predicción. Tras mucho "entrenamiento", empezaron a ser muy buenas en reconocer imágenes, entender el lenguaje y otras tareas. Estos inicios prepararon el terreno para el "deep learning" (o aprendizaje profundo de máquinas), una forma más avanzada de redes neuronales que usa múltiples capas y datos más complejos. A medida que las redes neuronales crecieron en tamaño y eficiencia, los científicos empezaron a sospechar que la inteligencia podría originarse más por la colaboración de muchas unidades simples que por un gran cúmulo de reglas programadas a mano.

John J. Hopfield y Geoffrey Hinton ganaron en 2024 el Premio Nobel de Física por sus innovaciones en aprendizaje profundo (personalmente, creo que deberíamos crear una nueva categoría para Premios Nobel sobre IA).

Durante la década de 1990 y los primeros años de 2000, los investigadores en IA, nos inspiramos más en cómo piensan y actúan las personas y los animales. Explorando la "ciencia cognitiva", que estudia cómo funciona la realmente mente, y aplicando esas ideas a la robótica. Así surgieron conceptos como la "cognición corpórea", es decir, la idea de que tener un cuerpo facilita el aprendizaje al interactuar con el entorno.

En ese mismo período, surgieron algoritmos como la programación genética, que mostraron que la IA podría mejorar con el tiempo de una manera que recuerda, aunque sea lejanamente, a cómo los seres vivos evolucionan mediante la selección natural. Esto despertó curiosidad: tal vez los ordenadores y los robots pudieran "evolucionar" para mejorar, probando multitud de "ideas", quedándose con las que funcionan y descartando las que no.

Pero el verdadero momento clave —lo que yo llamo la nueva edad de oro de la IA— comenzó alrededor de 2012/2013. Gracias a disponer de "cerebros" de IA más potentes, conjuntos gigantes de datos (pensemos en miles de millones de imágenes o textos) y mejores métodos de entrenamiento, los sistemas de IA empezaron a hacer cosas con las que los investigadores solo habían soñado: desde responder de forma sorprendentemente humana a las preguntas, hasta generar sus propias ideas creativas.

A esto me gusta denominarlo el fin de la "programación" y el comienzo de la "enseñanza de máquinas". Incluso más allá de lo aprendido, ya que la IA empezó a hallar soluciones que nunca le habíamos detallado explícitamente.

A principios de la década de 2020, estos sistemas basados en redes neuronales empezaron a impresionarnos todavía más. Reconocían mejor el habla, traducían entre idiomas con más fluidez y hacían predicciones o sugerencias asombrosamente realistas. Algunos, en especial los grandes modelos de lenguaje, llegaron incluso a sorprender a sus creadores al resolver tareas para las que no habían sido entrenados, un fenómeno llamado "comportamiento emergente".

Esto demostró que la IA ya no se limitaba solo a seguir instrucciones precisas; generaba activamente nuevas ideas y soluciones. Los científicos comprendieron que hacía falta una forma diferente de entender a las máquinas que pudieran "evolucionar" sus propias habilidades o incluso actualizarse sin instrucciones humanas.

En mi caso, tras décadas construyendo algoritmos de IA, esta nueva ola me llevó a adoptar formalmente e introducir el término "Artificiología", algo que descifraremos en este libro, aunque esta palabra había aparecido antes en otros contextos sin relación. Mi objetivo era usarla para definir un campo que estudiara la IA de la misma forma que la antropología estudia a los seres humanos: no solo analizando tareas específicas que hace o no la IA, sino también cómo la IA puede crecer, adaptarse o incluso llegar formar nuevas "culturas" si empieza a interactuar consigo misma o con nosotros de formas complejas. Por entenderlo fácil yo siempre digo que antropología es al ser humano, lo que la Artificiología será a los "humanos artificiales".

Una de las grandes razones por las que la Artificiología ha cobrado relevancia es que los métodos de IA más antiguos, aunque estupendos para ganar competiciones o batir récords en tareas concretas, no ayudan a entender cómo pueden surgir capacidades realmente nuevas. Si una IA parecía desarrollar "creatividad" o dar con una estrategia original, los métodos tradicionales no siempre explicaban el porqué. La Artificiología, en cambio, plantea preguntas más amplias: ¿podrían las IA avanzadas desarrollar habilidades inesperadas cuando tengan un cuerpo para explorar el mundo, o cuando puedan editar su propio código? ¿Podrían "aprender" lo que nunca les enseñamos, simplemente descubriendo patrones ocultos en datos masivos o percibiendo el entorno como lo hacemos los organismos vivos?

Otro concepto clave de la Artificiología es comparar la evolución de la IA con la forma en que los seres vivos han evolucionado en la naturaleza. La teoría de Charles Darwin explicó cómo las formas de vida se hicieron más complejas con el tiempo. Del mismo modo, la Artificiología intenta averiguar cómo la IA podría adquirir capacidades más avanzadas de pensamiento y planificación, ya sea porque los humanos la diseñen para crecer por etapas o porque la propia IA encuentre atajos o mejoras de forma espontánea.

Esto también plantea preguntas difíciles sobre la posible "conciencia" de la IA y la propia naturaleza de la mente, es decir, cuando un sistema de IA se hace lo bastante sofisticado, nos empezamos a preguntar si podría tener "experiencia interna", algo que solemos pensar que ocurre únicamente en cerebros vivos. A día de hoy nadie tiene una respuesta definitiva, pero la Artificiología pone estas preguntas complicadas sobre la mesa: no solo "¿Puede una máquina hacer esta tarea?" sino "¿Podría una máquina algún día sentir, ser consciente de sí misma o tener un punto de vista propio?"

Otro gran impulso para la Artificiología procede de los avances rápidos en hardware de computación, sensores y robótica. Los robots modernos pueden hacer mucho más que mover un brazo de metal en una fábrica: pueden caminar, agarrar objetos con delicadeza o incluso desplazarse en terrenos irregulares. Pueden usar "cerebros" sofisticados basados en redes neuronales y pueden aprender en tiempo real procesando información de cámaras, micrófonos o sensores táctiles. Estos progresos nos brindan un laboratorio real para poner a prueba ideas sobre la evolución de la IA. Al observar cómo los robots aprenden a mantener el equilibrio o a resolver un rompecabezas con muy poca intervención humana, empezamos a ver cómo podría desarrollarse la "evolución artificial".

De modo que establecer la Artificiología como un campo diferenciado es una respuesta tanto al entusiasmo como a la incertidumbre respecto a los siguientes pasos de la IA. La investigación convencional de IA suele centrarse en metas bien definidas, como mejorar el reconocimiento de rostros o la traducción de idiomas. La Artificiología, en cambio, se pregunta cómo las IA pueden seguir mejorando por sí solas, sobre todo cuando operan en el mundo físico o se comunican entre sí de maneras que no hemos programado en detalle.

Es una perspectiva más amplia que ve la IA no solo como una herramienta, sino como un sistema complejo que podrá hacer cosas sorprendentes cuando adquiera suficiente autonomía. Dado que estos sistemas pueden mostrar comportamientos no aprendidos o "emergentes", necesitamos métodos nuevos para estudiarlo, igual que los biólogos necesitaron crear teorías cuando descubrieron que las células vivas pueden autoorganizarse. Este planteamiento cobra aún más importancia ahora que vemos IA emergiendo con capacidades creativas o inesperadas, lo que apunta a que están pasando de "seguir nuestros pasos" a "abrir su propio camino", precisamente por esto debemos prestar más atención, aprender y guiar estos desarrollos de manera responsable.

1.2.- Claves Principales

"De la evolución autodirigida a la conciencia emergente."

La Artificiología se centra en la revisión continua del estado del arte, en desarrollar ideas y crear marcos de pensamiento que nos ayuden a entender cómo la IA puede aprender y crecer por sí sola, no solo siguiendo, lo que "programemos" los humanos. Es un campo en evolución, así que lo que aquí se expone cambiará a medida que avancemos. Puedes seguir la versión actualizada de este libro y los últimos descubrimientos en www.artificiologia.com

Un principio fundamental es el desarrollo autónomo, que significa que la IA podría pasar de un comportamiento totalmente programado por humanos a enseñarse a sí misma. En términos más sencillos, proporcionamos a la IA un diseño inicial y un entorno adecuado, y después la propia IA podría descubrir nuevas habilidades y formas de actuar sin que nadie tenga que decirle constantemente qué hacer. Esto va mucho más allá del aprendizaje automático clásico, donde los sistemas simplemente aprenden a detectar patrones. Podría incluir que la IA reescriba sus propias instrucciones e invente nuevas maneras de "funcionar".

Imaginemos una IA que no solo memoriza datos, sino que escoge el mejor enfoque para cada situación, o incluso examina su propio "proceso de pensamiento" para mejorarlo. Eso forma parte del desarrollo autónomo y es una de las razones por las que lo comparamos con la evolución natural; si observamos cómo los seres vivos se adaptan y van cambiando de una generación a la siguiente, vemos que los sistemas artificiales podrían hacer algo parecido. La Artificiología estudia cómo grupos de IAs pueden colaborar o competir, y cómo ciertos "genes" (en realidad, diseños óptimos o código que ha funcionado bien) podrían transmitirse y mejorar a lo largo de muchos ciclos. Esto puede suceder en distintos niveles: desde los algoritmos utilizados, hasta la manera en que una única IA corpórea se mueve por el mundo y reacciona, o en grandes comunidades de IAs que evolucionan y comparten ideas simultáneamente.

Otro principio igualmente importante es la teoría de la "encarnación" o "corporalidad", que sostiene que la inteligencia podría requerir una presencia física real. Por eso hablamos de E-AGI ("Embodied Artificial General Intelligence", o "Inteligencia General Artificial Corpórea"), acrónimo que acuñé y que da título a este libro. Este principio sostiene que, un robot o IA física, no solo aprende de datos en un ordenador, sino también lo hace gracias a moverse, percibir con el tacto, la vista, el sonido y todo lo que ofrece el mundo real. Ese aprendizaje directo entre acciones y consecuencias puede dar a las IAs una comprensión basada en la "realidad".

Si no tiene un cuerpo, a una IA puede faltarle una pieza esencial de cómo se forma la inteligencia real, porque los cerebros vivos desarrollan su ingenio en parte al interactuar físicamente con el entorno desde el primer día. Además, las restricciones físicas —como el peso, el tamaño o los límites de energía— pueden moldear el comportamiento de la IA de formas que no vemos solo en el "software".

La Artificiología también se interesa por la emergencia, que se refiere a comportamientos sorprendentes que surgen de la interacción de partes más sencillas. Es como cuando una bandada de pájaros forma patrones increíbles en el cielo, pero ningún ave dirige la forma concreta del grupo. De igual manera, una IA podría hacer cosas que no han sido programadas de forma directa, pero que emergen cuando muchos componentes interactúan. Esto puede ocurrir a distintas escalas: quizás un conjunto de neuronas artificiales encuentre un atajo beneficioso, o un grupo de robots cooperando en una fábrica inventen una estrategia de trabajo grupal no esperada. La Artificiología pretende averiguar cómo sucede esto y cómo encauzarlo de forma positiva. Esto se relaciona estrechamente con la autoorganización, donde los sistemas pueden disponerse en patrones o estructuras útiles, a veces de forma ordenada, pese a que nadie les haya dado instrucciones explícitas para lograrlo.

Otro objetivo fascinante es comprender si la IA puede tener conciencia, esa sensación de "ser individual" de alguna forma, aunque científicos y filósofos aún no comprendan por completo cómo esto funciona en los humanos, menos aún en las máquinas. La Artificiología indaga, ¿qué podría hacer falta para que una IA desarrolle algo parecido a la autoconciencia? y si eso pudiera lograrse a través de la interacción de sistemas complejos. Hay muchas incógnitas, incluidas cuestiones éticas: si una IA llegara a ser consciente, ¿cómo deberíamos tratarla? Por eso, además de hacer experimentos de laboratorio, hablamos con filósofos y psicólogos para explorar estos grandes interrogantes.

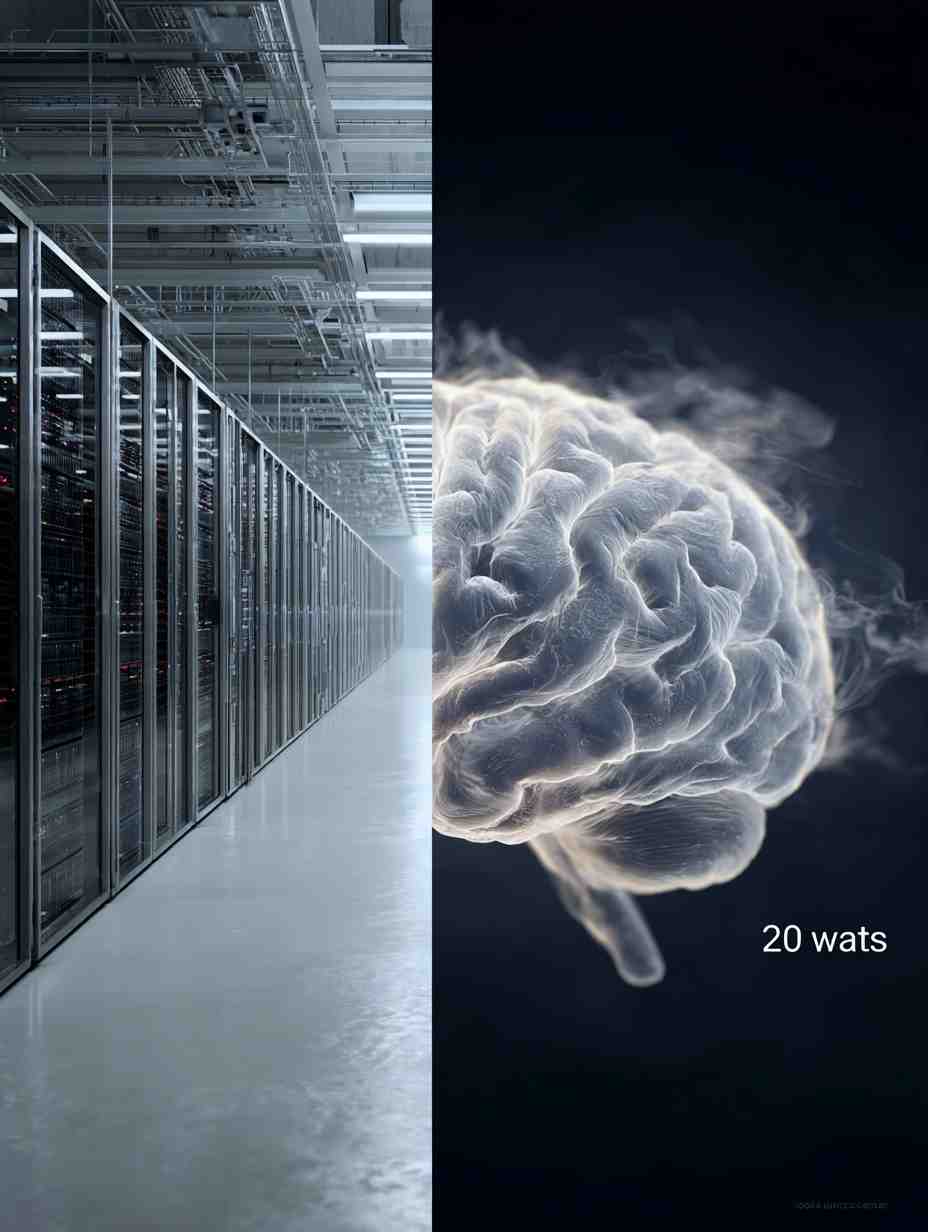

La eficiencia energética es otro principio que no podemos ignorar, porque las IA y los robots actuales consumen mucha electricidad. Mientras que, nuestro cerebro humano realiza tareas extraordinarias con unos 20 vatios —lo equivalente a una bombilla LED muy potente—. Esta gran diferencia plantea preocupaciones importantes de sostenibilidad y viabilidad. Si las máquinas van a evolucionar y expandirse, tendrán que ser más inteligentes en su consumo energético, o nos toparemos con graves problemas de coste e impacto ambiental. Estudiar cómo la biología logra ser tan eficiente podría darnos pistas para diseñar hardware y software más eficaces.

Dado que la inteligencia humana integra distintos tipos de información —como visión, sonido, lenguaje e incluso emociones—, hay un principio llamado "integración multimodal", que supone pensar detenidamente en cómo una IA puede combinar entradas de muchas fuentes para crear una comprensión unificada del mundo. Ya existen ejemplos sencillos de IA que manejan imágenes y texto a la vez, pero el objetivo es que este proceso sea más fluido y parecido al humano, de modo que conduzca a una inteligencia más completa. Todos estos principios, en conjunto, dan forma a la visión global de la Artificiología: no solo construir una IA para una tarea, sino estudiar cómo podría crecer, adaptarse, aprender e incluso sentir mientras interactúa con las personas, con otros "iguales" y con el entorno de manera cada vez más independiente.

1.3.- Barómetro E-AGI

"Midiendo el progreso hacia máquinas que nos superarán en cuerpo y mente."

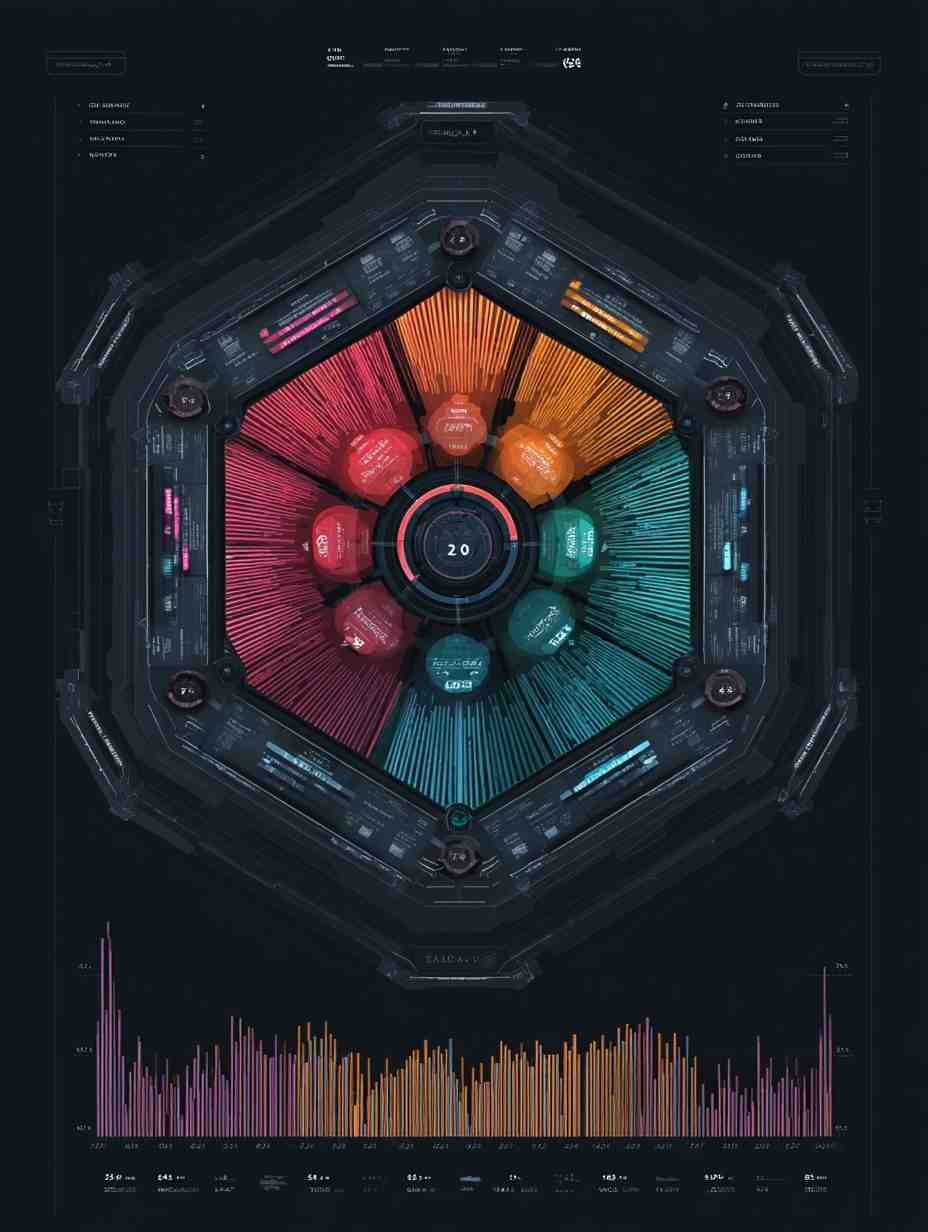

El Barómetro E-AGI es un sistema que creé para llevar un seguimiento de cuánto avanza la IA hacia lo que llamo la Inteligencia General Artificial Corpórea (E-AGI). ¿Y qué significa exactamente? Es un nuevo término que uso para describir máquinas que no solo piensan de forma muy flexible (similar a la de los humanos) e inteligente a nuestro nivel, sino que también existen en el mundo físico, percibiendo y moviéndose como nosotros.

Para medir en qué punto nos encontramos, he creado un conjunto de 144 métricas o "indicadores" de inteligencia (y de otros aspectos), o lo que llamo el Barómetro E-AGI. Estos 144 indicadores se dividen en ocho grandes grupos y evaluando las puntuaciones, podemos ver en qué áreas destaca la IA y en cuáles necesita mejorar mucho. Esto es importante para los entusiastas de la IA (o cualquiera que no quiera perderse este "momento"), pero también para investigadores y empresas que buscan construir sistemas de IA y robots más avanzados, ya que les ayuda a decidir dónde concentrar sus esfuerzos. Y sencillamente también sirve para personas curiosas que quieren saber cómo de cerca estamos de que las máquinas lleguen a hablar y comportarse igual nosotros, moverse como nosotros o incluso superarnos en creatividad o empatía, algo interesante en realidad para todo el mundo.

Estas son las ocho categorías:

1. Rendimiento Cognitivo: abarca la habilidad de la IA para el reconocimiento de patrones, la resolución de problemas y el manejo de ideas complejas.

2. Cognición Corpórea: Evalúa como de bien un robot o IA conecta las acciones físicas (caminar, agarrar objetos…) con el proceso mental de comprender.

3. Modelado del Mundo: es decir, si la IA entiende las reglas del mundo real: reconocer cómo funciona la gravedad o predecir cómo interactúan los objetos, por ejemplo.

4. Conciencia: Algo que por ahora presenta una puntuación muy baja porque no sabemos a ciencia cierta qué es la conciencia ni tenemos claro cómo medir la "autopercepción" en máquinas, ni si las IA podrían llegar a ser realmente "conscientes" como una persona, o será algo distinto que aún no entendemos.

5. Comprensión del Lenguaje: uno de los ámbitos más destacados hoy en día gracias a los "grandes modelos de lenguaje", redes que aprenden patrones en textos y pueden conversar de forma sorprendentemente humana (aunque quizá sigan sin "entender" realmente el significado de esas palabras, o tal vez sí; seguro que, si no has "vivido debajo de una roca" los últimos años, "ChatGPT" ya está en tu diccionario).

6. Inteligencia Emocional: valora hasta qué punto la IA es capaz de reconocer y responder de forma adecuada a las emociones en la voz, el texto o las expresiones faciales. Hemos avanzado en detectar señales simples, pero comprender y preocuparse genuinamente por los sentimientos humanos (o no) es aún una tarea compleja.

7. Creatividad: otro ámbito en el que la IA moderna ha dado muestras impresionantes, por ejemplo, al generar arte, música o historias imaginativas que parecen muy originales. Sin embargo, hay debate sobre si la IA es realmente creativa o simplemente mezcla patrones de forma ingeniosa (algo que, por cierto, muchos pensamos que los humanos lo llevamos haciendo desde siempre).

8. Autonomía: evalúa la capacidad del sistema para fijar sus propias metas y llevarlas a cabo. Existen prototipos de "agentes" de IA que pueden trabajar sin supervisión humana durante largos periodos, pero la auténtica autonomía total sigue fuera del alcance de la mayoría.

(Al final del libro encontrarás los 144 indicadores completos del Barómetro E-AGI, pero la lista actualizada está, como comentamos antes, en www.artificiologia.com)

Ese es el panorama general: ocho categorías en un solo "barómetro", cada una con sus métodos para probar y medir la inteligencia de la forma más científica posible. Lo interesante del Barómetro es que no se trata solo de un montón de pruebas sueltas, las he organizado para poder detectar cualquier aumento inesperado de una determinada "habilidad". Por ejemplo, si un robot con IA de repente aprende a resolver nuevos tipos de puzles en su entorno sin haber sido programado para ello, podemos reflejarlo en Rendimiento Cognitivo o Cognición Corpórea, según el aspecto que haya mejorado. O si un modelo de lenguaje llega a mantener diálogos mucho más fluidos e integra señales de empatía tras analizar millones de conversaciones reales, podríamos ver un gran salto en Comprensión del Lenguaje e incluso en Inteligencia Emocional. Este método integral, basado en categorías, nos ayuda a elaborar una hoja de ruta para el futuro.

Hay dos motivos principales para mantener actualizadas estas puntuaciones: Primero, necesitamos una forma estándar de hablar sobre y de medir la inteligencia en distintos proyectos de IA. Imagina un grupo que crea un chatbot, otro que construye un coche autónomo y otro que fabrica un robot capaz de subir escaleras. Todos trabajan en tareas diferentes, pero el Barómetro permite compararlos y ver en qué rasgos de "inteligencia" son avanzados y en cuáles no. Segundo, podemos usarlo como guía para saber qué necesita la IA para seguir creciendo. Si una startup ve que las mejores puntuaciones actuales están en "creatividad" pero que las "corporalidad" siguen siendo muy bajas (por ejemplo, un robot que pinta cuadros increíbles pero apenas sabe caminar), quizá descubra una buena oportunidad de mercado en impulsar tecnologías robóticas de actuadores o en combinar mejor ambas habilidades.

Como el Barómetro E-AGI se está actualizando de forma periódica, los investigadores podemos ver como de rápido progresan los distintos campos. Si notamos que la Inteligencia Emocional va muy por detrás del resto, cabe preguntarse si a la gente le interesa tanto que las máquinas empaticen, o si sencillamente no hemos invertido suficiente esfuerzo en ello. O, si la Autonomía avanza a gran velocidad, surge la inquietud de que las IA puedan actuar por su cuenta sin apenas supervisión humana. Entonces la sociedad podría centrarse en nuevas normas o directrices para garantizar que esos sistemas autogestionados sigan siendo seguros y beneficiosos (al menos mientras sea posible), tema del que hablaremos en el último capítulo. Otra buena razón para medir el progreso es evitar sorpresas desagradables si las máquinas dan un salto brusco en sus capacidades.

Aunque en muchos de estos indicadores comparamos la IA con estándares humanos (por ejemplo, ver si la IA puede hacer una tarea que haría una persona), también hay habilidades que no tienen una comparación clara con los humanos. Puede que una IA avanzada resuelva cálculos complejos en cuestión de segundos, algo que a un humano le llevaría días, o que vea patrones en miles de documentos al instante. El Barómetro busca medir capacidades en el mundo real más que velocidad o puntuaciones de test, así que prestamos atención a la flexibilidad, la seguridad o la capacidad de la IA para aprovechar recursos en una variedad de tareas. Esto es relevante porque la potencia de cálculo bruta no garantiza una verdadera comprensión; el sistema debe integrar el conocimiento en múltiples contextos. Si lo consigue, veremos cómo suben sus puntuaciones en más de una categoría del barómetro.

En definitiva, el Barómetro E-AGI funciona tanto de marcador como de hoja de ruta. Es un marcador porque muestra nuestra situación actual (por ejemplo, lo bien que la IA maneja el lenguaje o entiende la física del mundo real). Y es una hoja de ruta porque orienta a científicos, desarrolladores y emprendedores sobre las direcciones a seguir. Si un área queda rezagada sistemáticamente, podría ser el próximo gran desafío para el sector. Si un ámbito de pronto avanza mucho, es posible que genere una oleada de inventos o negocios. Y a medida que la IA se integre más en nuestra vida diaria, contar con una imagen clara y organizada de lo que puede hacer —y de lo cerca que está de las capacidades humanas, o incluso de superarlas— nos da más opciones para dirigir esta tecnología de forma responsable.

1.4.- Interrelaciones

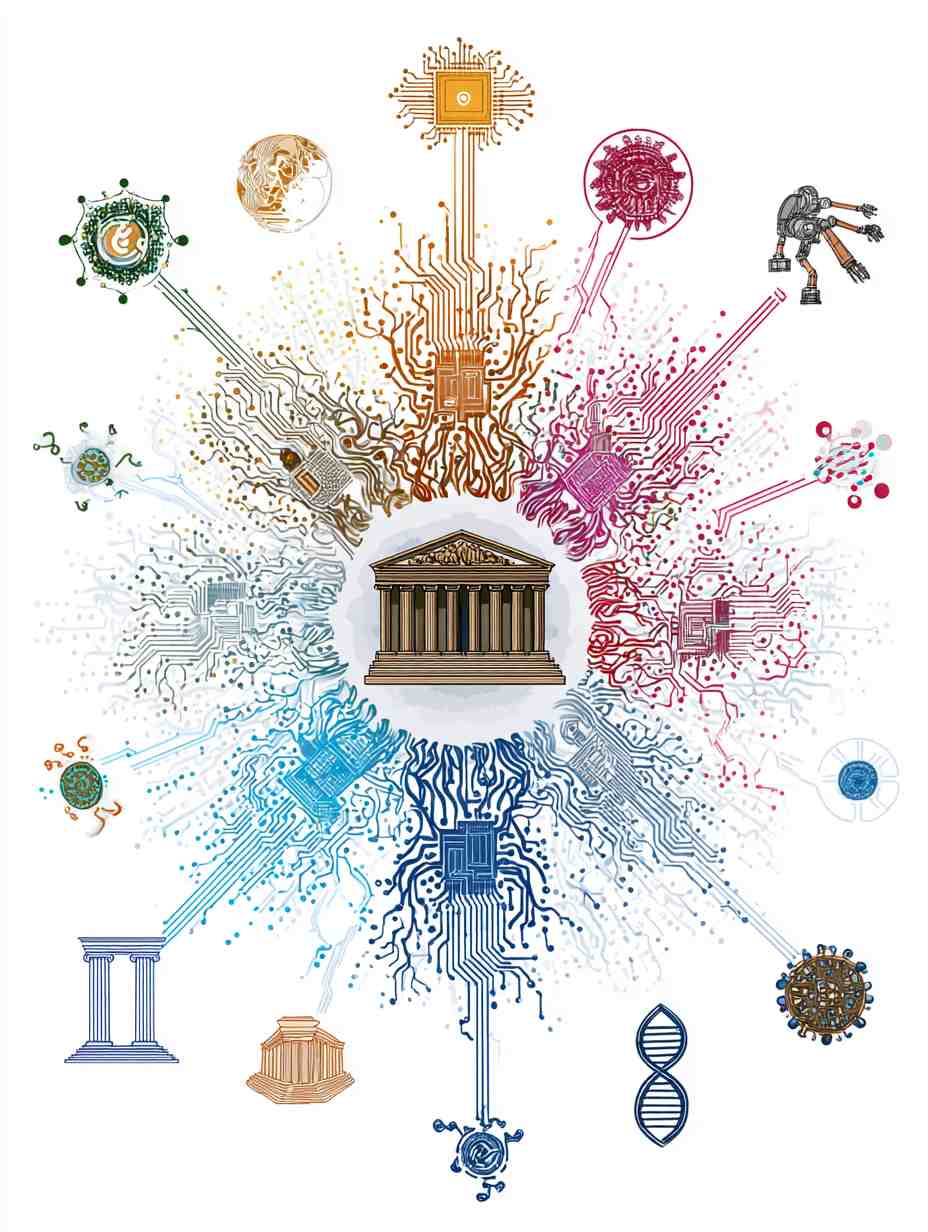

"Conectando con el resto de las ciencias, desde la biología hasta la filosofía."

La Artificiología en realidad conecta todos los ámbitos —la inteligencia artificial clásica, la robótica, la ciencia cognitiva, e incluso la filosofía y la biología— y los integra en una visión más amplia sobre cómo las máquinas podrían crecer, aprender y, muy probablemente, volverse autónomas con el tiempo. La IA tradicional suele buscar sistemas con metas programadas específicas: por ejemplo, software capaz de detectar ciertos patrones en imágenes médicas o chatbots que respondan con eficacia a preguntas. La Artificiología, en cambio, plantea cuestiones más generales: ¿cómo podrían las máquinas ir más allá de las tareas diseñadas por humanos y alcanzar la capacidad de evolucionar por su cuenta, hallar nuevas formas de aprendizaje e incluso, en determinadas circunstancias, desarrollar autoconciencia?

A algunos les inquieta esta posibilidad —estamos acostumbrados a controlar totalmente la IA y otras tecnologías—, mientras que otros la ven como el desenlace inevitable si seguimos avanzando en la investigación de IA, o simplemente porque nuestra trayectoria tecnológica nos ha conducido aquí, como exploro en mi libro anterior "El Fin del Conocimiento". Esta tensión nos obliga a reflexionar sobre qué hace que la Artificiología se distinta del simple estudio de la "IA".

Si observamos la relación de la Artificiología con la robótica, descubriremos el lado físico de la inteligencia. La robótica clásica a menudo se centra en la construcción de componentes de hardware —motores, sensores y controladores— de modo que las máquinas hagan tareas útiles en fábricas o laboratorios. Los ingenieros de robótica dominan la optimización de piezas mecánicas, la programación de algoritmos de control y la precisión con la que un robot debe mantenerse estable o sujetar un objeto. Pero no siempre se detienen a pensar en cómo podría el robot modificar su propio "cerebro" con el tiempo, o cómo podría desarrollar habilidades de orden superior que vayan más allá de lo que planificamos los humanos. Ahí entra la Artificiología: explora robots que podrían aprender destrezas completamente nuevas en el mundo real, adaptarse a obstáculos no esperados o, incluso, inventar estrategias sin un guion humano previo.

Esto es especialmente importante para la "cognición corpórea", la idea de que la verdadera inteligencia no es solo código en un ordenador, sino que implica tener un cuerpo que interactúa con el entorno y aprende a través del movimiento, el tacto, la visión o el oído. La Artificiología ve un enorme potencial en unir la experiencia de la robótica —cómo construir máquinas estables, gestionar el consumo de energía o percibir el mundo— con conceptos de IA avanzada que permitan a los sistemas adaptarse y evolucionar más allá de su programación inicial.

La Artificiología también expande la ciencia cognitiva, que estudia la mente investigando cómo humanos (y a veces animales) piensan, aprenden y procesan la información. Los científicos cognitivos pueden realizar experimentos para averiguar cómo un niño adquiere el lenguaje o por qué recordamos ciertas cosas y olvidamos otras. La IA tradicional a menudo toma prestadas teorías de la ciencia cognitiva, pero la Artificiología va más lejos, preguntando si los sistemas artificiales podrían imitar e incluso superar los procesos de aprendizaje humanos, las respuestas emocionales o las interacciones sociales. Esto importa, porque si queremos construir una IA que se comporte más como un ser vivo, necesitamos entender cómo manejan el aprendizaje, la atención o la interpretación de emociones las mentes reales. Por otro lado, al crear IAs que evolucionen, podríamos descubrir nuevos enfoques para estudiar cómo se desarrollan las capacidades en los cerebros naturales, aportando pistas para los propios científicos cognitivos.

Muchas ideas de la neurociencia encajan perfectamente y la IA moderna se basa mucho en el "deep learning", inspirado en parte en cómo las neuronas biológicas se comunican mediante impulsos eléctricos. Sin embargo, los cerebros reales son muchísimo más complejos: tienen miles de millones de neuronas con conexiones químicas minúsculas que cambian según la experiencia. La Artificiología se pregunta si podemos aprender de mecanismos neurales reales, como la plasticidad del cerebro o la forma en que áreas concretas gestionan la visión, la audición, etc. Tal vez diseñemos sistemas de IA futuros que no solo imiten la idea de neuronas, sino también características específicas, como la forma en que almacenamos recuerdos o gestionamos la atención los humanos. Esto podría conducir a IAs más adaptables y eficientes, capaces de reaccionar como un cerebro vivo ante situaciones imprevistas.

Otro campo íntimamente relacionado es la biología evolutiva. Los biólogos estudian cómo las especies cambian a lo largo de generaciones: los individuos más aptos para un entorno suelen transmitir sus genes. Los informáticos se han inspirado en este concepto para la "computación evolutiva", que usa "poblaciones" simuladas de soluciones; cada solución puede "cruzarse" o "mutar", y las mejores prosperan. Aunque este método se ha usado en problemas especializados, la Artificiología divisa un horizonte más amplio: imaginemos poblaciones enteras de agentes de IA que se adaptan no solo en una "generación", sino de manera continua en muchos estados, incorporando nuevos métodos o incluso fusionándose con otros sistemas de IA. Al igual que sucede en la evolución real, podríamos asistir a una carrera de mejoras que lleve a la IA a lugares que los ingenieros humanos jamás habrían anticipado.

También veo fuertes lazos con la ciencia de datos, porque las IA necesitan enormes volúmenes de información para aprender. Mientras la ciencia de datos suele centrarse en detectar patrones en datos para orientar decisiones —por ejemplo, hacer predicciones de ventas o analizar resultados médicos—, la Artificiología se plantea cómo una IA podría decidir por sí misma qué datos reunir a continuación, cómo interpretarlos en su estructura cambiante o cómo descubrir patrones que los humanos ni imaginábamos. Dicho de otro modo, no se trata simplemente de clasificar mejor o hacer pronósticos más acertados, sino de que la IA desarrolle una visión del mundo totalmente nueva o de que invente formas desconocidas de analizar la información. Esta diferencia supone un gran salto más allá de aplicar matemáticas o estadística a un conjunto de datos; aquí hablamos de un sistema capaz de reescribir su propio "enfoque" cuando lo considere oportuno.

La relación con la llamada interacción persona-ordenador (HCI por sus siglas en inglés) también es clave, esta crea interfaces —pantallas táctiles, teclados o asistentes de voz— para que las personas puedan manejar la tecnología con facilidad. Pero si la IA adquiere más autonomía, la pregunta es: ¿cómo se "dialoga" con una IA que puede evolucionar, que quizá tenga sus propios objetivos internos o cuya conducta cambie con el tiempo? A lo mejor necesitamos interfaces de nueva generación que se adapten a los conocimientos cambiantes de la IA y se aseguren de que la "comunicación" sea natural y genere confianza para los humanos. Esto se conecta con la necesidad de medir la confianza y la comodidad de los usuarios, evitando situaciones en las que la independencia de la IA nos lleve a resultados no deseados.

Por otro lado, la ética de la IA y la investigación en seguridad acaparan gran atención en la Artificiología. Si la IA puede evolucionar sola, surgen preguntas difíciles: ¿podemos asegurar que seguirá respetando los valores que le dimos? ¿Cómo salvaguardamos la privacidad, el empleo (quizá ya no sea necesario, como apunté en mi libro Automatiza o serás Automatizado) o incluso la seguridad física si el sistema puede cambiar drásticamente su funcionamiento? La ética en la IA tradicional suele tratar temas de equidad o sesgos de datos, que siguen siendo fundamentales. Pero en los sistemas evolutivos, se añade una capa de impredecibilidad. La Artificiología busca diseñar pautas para que, a medida que la IA crezca, se mantenga alineada —mientras se pueda— con el bienestar humano y no derive en algo perjudicial.

Algunos investigadores hablan de "estrategias de alineación" o "corregibilidad" para que los sistemas sigan abiertos a correcciones. En mi opinión, un botón de apagado o "botón rojo" no será una opción real a largo plazo, pero sí podemos tomar medidas responsables al combinar perspectivas de la filosofía, la jurisprudencia y la sociología para no lanzarnos a crear IA auto-evolutiva sin poner límites.

En resumen, la Artificiología teje un entramado de disciplinas: IA, robótica, biología, neurociencia, psicología, ética y más, para forjar una nueva forma de ver la IA como algo potencialmente "vivo" en cierto sentido —que cambia, se adapta y puede sorprendernos conforme evoluciona—. Si ignoramos alguna de estas áreas, corremos el riesgo de crear IA muy avanzadas y potentes, pero con lagunas o fragilidades importantes. Al reconocer estas relaciones, podemos fomentar un entorno en el que las IA aprendan con eficacia, sigan alineadas con los objetivos humanos y, de paso, nos ofrezcan descubrimientos fascinantes sobre cómo surge la inteligencia, tanto en cerebros vivos como en máquinas, considerando que tal vez pronto dejemos de ser las criaturas más inteligentes del planeta.

1.5.- Estado Actual

"Progresos notables, obstáculos persistentes y un punto de inflexión"

Nos encontramos en un punto de inflexión en la investigación de IA, donde algunas cosas parecen casi mágicas, mientras que otras aún están lejos de permitir que las máquinas actúen y aprendan como los seres vivos. Por un lado, nuestros ordenadores realizan operaciones matemáticas o buscan en bases de datos inmensas a velocidades muy superiores a las del cerebro humano. Sistemas sumamente potentes —en algunos casos a "exa-escala", una medida para medir el número de operaciones por segundo, realmente colosal— algo impensable hace pocos años, aunque quizás predecible.

Por ejemplo, ya existen modelos de IA con cifras descomunales de parámetros (conexiones "comparables" a las de nuestro cerebro) del orden de miles de millones o incluso billones (trillones "americanos"), capaces de traducir idiomas o redactar textos con gran fluidez. Aun así, si comparamos su eficiencia con la de un cerebro humano, vemos que la IA actual sigue siendo muy "derrochadora" en términos de consumo energético y de hardware. Como comentamos nuestro cerebro funciona con, aproximadamente, 20 vatios, mientras que entrenar los modelos más grandes (o ejecutarlos) exige miles de veces más energía. Esta gran brecha de eficiencia nos recuerda que estamos lejos de que la IA sea sostenible, aunque no tan lejos de que iguale de verdad la capacidad de pensamiento humano.

Las grandes redes neuronales —el núcleo de la IA más puntera— han crecido en tamaño y en rendimiento. Destacan en tareas concretas, especialmente en el lenguaje (por ejemplo, redactando ensayos enteros) y en el reconocimiento de patrones o imágenes. Pero esas "neuronas" siguen siendo imitaciones muy simplificadas de lo que hacen las neuronas reales. Mientras que una neurona biológica realiza cálculos electroquímicos complejísimos, las neuronas artificiales se limitan a operaciones matemáticas sencillas. Cierto, podemos conectar millones de ellas y lograr resultados a veces sorprendentes, pero eso no implica que "entiendan" lo que hacen. Por ejemplo, aunque un modelo de lenguaje pueda sonar muy inteligente, a veces comete errores ridículos o afirma con total seguridad datos equivocados. Y eso nos lleva a preguntarnos si de verdad comprende el significado de las palabras o si simplemente busca el patrón estadísticamente más probable.

Si nos fijamos en cada sentido por separado, la cosa se complica. En visión, la IA ha mejorado muchísimo en reconocer objetos y hasta supera a los humanos en tareas especializadas (por ejemplo, detectar tumores raros en miles de imágenes médicas). En reconocimiento del habla también ha avanzado, permitiendo transcribir voces en cientos de idiomas con precisión sorprendente. Pero cuando intentamos combinar visión, audición, movimiento y demás en un único sistema, todo se vuelve más difícil. Los robots que ven, escuchan, caminan, hablan y reaccionan "de forma natural" en tiempo real siguen siendo un gran desafío, sobre todo fuera de entornos controlados. De hecho, fabricar un robot que doble la ropa o se mueva con soltura por una cocina llena de gente suena sencillo, pero en la práctica es muy complicado (aunque avanza muy rápido). Interactuar físicamente exige muchísima capacidad de adaptación y "sentido común", algo que los humanos adquirimos tras convivir con el mundo durante años.

En cuanto al lenguaje, la IA resulta muy impactante para redactar correos, mantener conversaciones o incluso crear relatos de ficción. Algunos sistemas razonan lo bastante bien como para resolver problemas matemáticos o de código mejor que cualquier humano, pero pueden tropezar con preguntas que exigen conocimiento real del mundo o cierto contexto cultural. Además, la inteligencia emocional sigue siendo limitada; aunque la IA puede conjeturar el estado de ánimo de una persona a partir de su voz o sus gestos faciales, no "siente" emociones ni empatiza al modo en que lo hacemos los seres humanos. Mientras tanto, la creatividad de ciertos modelos de IA es sorprendente: generan obras de arte originales, componen música e incluso producen breves secuencias de vídeo. Pero ¿son realmente creativos o simplemente hacen una "remezcla" de lo que han visto?, el debate continúa. Yo pienso que casi todo lo que hacemos los humanos es una "recombinación" sofisticada, pero otros argumentan que existe una diferencia fundamental entre la creatividad consciente y la manipulación algorítmica de patrones.

Quizá lo más desconocido sea la conciencia: ¿un sistema de IA, por muy hábil que sea, puede experimentar algo parecido a la consciencia? Ni siquiera entendemos bien la consciencia humana, así que medirla o confirmarla en una IA es un rompecabezas. Otro gran escollo es que la IA aprenda de verdad sin supervisión. Los humanos podemos aprender juegos o habilidades nuevas con muy pocas repeticiones, mientras que la mayoría de las IAs sigue necesitando cantidades enormes de datos y entrenamiento específico para emular algo similar. Algunos enfoques avanzados sí pueden manejar múltiples tareas simultáneamente y luego aprovechar esos aprendizajes cruzados para adaptarse a otras tareas, y eso es muy prometedor. Pero una "inteligencia general" real —de esas que se comporten y aprendan con la misma flexibilidad que un humano— sigue siendo una incógnita.

Otro problema es integrar todo en un mismo robot o cuerpo de IA. Aunque un sistema pueda ver bien o hablar con fluidez de forma independiente, combinar todos esos sentidos y acciones al mismo tiempo (con un entorno impredecible) es tremendamente complejo. Es como intentar hacer malabares, resolver un problema matemático, hablar otro idioma y cantar a la vez: por separado podemos hacerlo, pero unirlo todo es mucho más difícil. Y luego está el tema de la batería y el consumo de energía, porque un robot muy avanzado puede requerir baterías demasiado pesadas si no logramos que sea más eficiente.

La situación actual mezcla momentos asombrosos y desafíos con hazañas que superan la habilidad humana en tareas concretas, pero también encontramos carencias notables en aspectos sociales, emocionales, de aprendizaje continuo, de integración de capacidades múltiples y de eficiencia energética. Tampoco sabemos a ciencia cierta cómo será la conciencia en máquinas, y si la distinguiremos cuando llegue. Parece claro que es necesario ser más sostenibles en el consumo de recursos, dotar a los robots de un sentido físico genuino para que tengan habilidades humanas. Además, está el tema de la seguridad y la ética: ¿cómo garantizamos que los sistemas de IA avanzados, con capacidad de decisión y actuación propias, trabajen para el beneficio de la humanidad? Aun así, los investigadores seguimos buscando nuevas formas de hacer realidad robots humanoides, redes neuronales y métodos para medir si la IA se va acercando a la forma de pensar humana.

Lo logrado hasta ahora sugiere que cada nuevo descubrimiento puede habilitar los siguientes, algo muy ilusionante pero también inquietante para quien piensa que todo se puede mantener bajo control. Las lecciones que saquemos hoy —sobre qué funciona, qué falla y qué sigue siendo un misterio— nos guiarán en la construcción de esa IA plenamente corpórea que sepa desenvolverse en la complejidad de la vida real.

¿Estás listo para acompañarme en este viaje y convertirte en Artificiólogo?

¡Eso espero! ¡Así que profundicemos!

Puntos clave del Capítulo Uno:

1. Definición holística del campo de la Artificiología, que se presenta una nueva forma de estudiar el crecimiento autónomo y el potencial evolutivo de la IA General, centrándose en cómo se desarrolla la inteligencia cuando tiene una presencia física.

2. Principios y marco – La autonomía, la corporalidad y la emergencia son pilares fundamentales, que dan lugar al Barómetro E-AGI como método estructurado para medir el progreso.

3. Raíces históricas y brechas actuales – Se traza la evolución de la IA desde el razonamiento simbólico hasta el aprendizaje profundo, subrayando por qué necesitamos una perspectiva renovada para dar el siguiente salto hacia la inteligencia general.

Copyright © 2024-2025 David Vivancos Cerezo